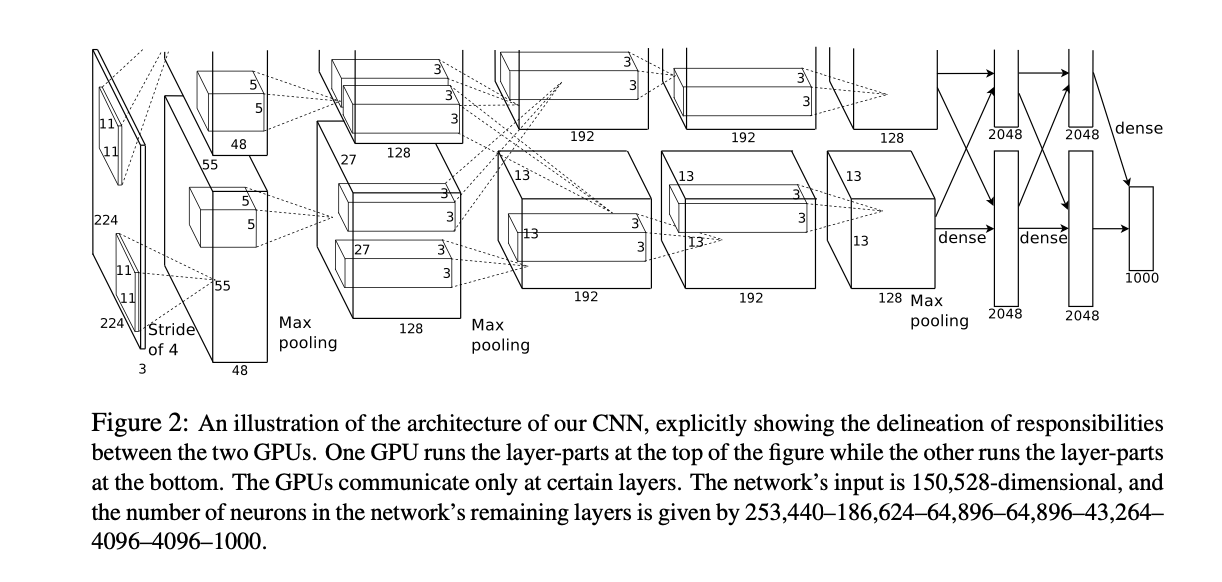

AlexNetの構造

ImageNet Classification with Deep Convolutional Neural Networksが元論文みたいです。

著者の1人のAlex Krizhevskyさんの名前からAlexNetとなっているみたいです。

構造

下のような構造になっています。

入力する画像のサイズは、(224 x 224)です。

畳み込み層が5層、全結合層が2層からなるネットワーク

Pytorchによる実装

One weird trick for parallelizing convolutional neural networksのネットワークを構築します。

pytorch_vision_alexnet/で採用されています。torchvisionで使用できます。

class Alexnet(nn.Module):

def __init__(self, ):

super(AlexNet, self).__init__()

self.features = nn.Sequential(

nn.Conv2d(3, 64, kernel_size=11, stride=4, padding=2),

nn.ReLU(inplace=True),

nn.MaxPool2d(kernel_size=3, stride=2),

nn.Conv2d(64, 192, kernel_size=5, padding=2),

nn.ReLU(inplace=True),

nn.MaxPool2d(kernel_size=3, stride=2),

nn.Conv2d(192, 384, kernel_size=3, padding=1),

nn.ReLU(inplace=True),

nn.Conv2d(384, 256, kernel_size=3, padding=1),

nn.ReLU(inplace=True),

nn.Conv2d(256, 256, kernel_size=3, padding=1),

nn.ReLU(inplace=True),

nn.MaxPool2d(kernel_size=3, stride=2),

)

self.avgpool = nn.AdaptiveAvgPool2d((6, 6))

self.classifier = nn.Sequential(

nn.Dropout(),

nn.Linear(256 * 6 * 6, 4096),

nn.ReLU(inplace=True),

nn.Dropout(),

nn.Linear(4096, 4096),

nn.ReLU(inplace=True),

nn.Linear(4096, num_classes),

)

def forward(self, x):

x = self.features(x)

x = self.avgpool(x)

x = torch.flatten(x, 1)

x = self.classifier(x)

return x